-

1 условная дифференциальная энтропия случайной последовательности

условная дифференциальная энтропия случайной последовательности

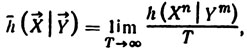

Отнесенная к единице времени условная дифференциальная энтропия отрезка непрерывной (по множеству значений компонент) случайной последовательности при условии заданного соответствующего отрезка другой непрерывной случайной последовательности в пределе при стремлении к бесконечности длины отрезка; ее выражение имеет вид

где и

и  — непрерывные случайные последовательности, a n и m —числа компонент последовательностей

— непрерывные случайные последовательности, a n и m —числа компонент последовательностей  и

и  на отрезке длительности T.

на отрезке длительности T.

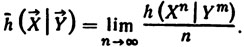

Примечание. Условная дифференциальная энтропия случайной последовательности, отнесенная к одной компоненте, имеет вид

Примечание. Длина отрезка Т может иметь размерность, отличную от времени.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > условная дифференциальная энтропия случайной последовательности

-

2 условная дифференциальная энтропия случайной последовательности

General subject: conditional differential random-sequence entropy (отнесенная к единице времени условная дифференциальная энтропия отрезка непрерывной (по множеству значений компонент) случайной последов)Универсальный русско-английский словарь > условная дифференциальная энтропия случайной последовательности

См. также в других словарях:

Entropy (information theory) — In information theory, entropy is a measure of the uncertainty associated with a random variable. The term by itself in this context usually refers to the Shannon entropy, which quantifies, in the sense of an expected value, the information… … Wikipedia

условная дифференциальная энтропия случайной последовательности — Отнесенная к единице времени условная дифференциальная энтропия отрезка непрерывной (по множеству значений компонент) случайной последовательности при условии заданного соответствующего отрезка другой непрерывной случайной последовательности в… … Справочник технического переводчика

Mathematics and Physical Sciences — ▪ 2003 Introduction Mathematics Mathematics in 2002 was marked by two discoveries in number theory. The first may have practical implications; the second satisfied a 150 year old curiosity. Computer scientist Manindra Agrawal of the… … Universalium

List of mathematics articles (R) — NOTOC R R. A. Fisher Lectureship Rabdology Rabin automaton Rabin signature algorithm Rabinovich Fabrikant equations Rabinowitsch trick Racah polynomials Racah W coefficient Racetrack (game) Racks and quandles Radar chart Rademacher complexity… … Wikipedia

probability theory — Math., Statistics. the theory of analyzing and making statements concerning the probability of the occurrence of uncertain events. Cf. probability (def. 4). [1830 40] * * * Branch of mathematics that deals with analysis of random events.… … Universalium

Information theory — Not to be confused with Information science. Information theory is a branch of applied mathematics and electrical engineering involving the quantification of information. Information theory was developed by Claude E. Shannon to find fundamental… … Wikipedia

List of mathematics articles (C) — NOTOC C C closed subgroup C minimal theory C normal subgroup C number C semiring C space C symmetry C* algebra C0 semigroup CA group Cabal (set theory) Cabibbo Kobayashi Maskawa matrix Cabinet projection Cable knot Cabri Geometry Cabtaxi number… … Wikipedia

Kullback–Leibler divergence — In probability theory and information theory, the Kullback–Leibler divergence[1][2][3] (also information divergence, information gain, relative entropy, or KLIC) is a non symmetric measure of the difference between two probability distributions P … Wikipedia

Cauchy distribution — Not to be confused with Lorenz curve. Cauchy–Lorentz Probability density function The purple curve is the standard Cauchy distribution Cumulative distribution function … Wikipedia

Asymptotic equipartition property — In information theory the asymptotic equipartition property (AEP) is a general property of the output samples of a stochastic source. It is fundamental to the concept of typical set used in theories of compression.Roughly speaking, the theorem… … Wikipedia

Dirichlet distribution — Several images of the probability density of the Dirichlet distribution when K=3 for various parameter vectors α. Clockwise from top left: α=(6, 2, 2), (3, 7, 5), (6, 2, 6), (2, 3, 4). In probability and… … Wikipedia